SIGGRAPH 2023技術論文研究展示了進壹步推進角色動畫領域的創新

自50年前成立以來,SIGGRAPH壹直是不斷發展的計算機圖形學和交互技術領域的創新思想和創新研究的中心。這些創新給我們帶來了逼真的CGI,或電腦生成的圖像,幫助傳統的電影制作和遊戲進入了壹個新時代。

今年,世界各地的計算機科學家、藝術家、開發人員和行業專家於8月6日至10日在洛杉磯召開SIGGRAPH 2023會議。會議主席Erik Brunvand指出,今年SIGGRAPH的主題是將2023年定為“SIGGRAPH時代”,以紀念行業、社區和組織的完整年表——過去、現在和遙遠的未來。

SIGGRAPH-Learning物理規則

CGI創新的壹個例子是角色動畫的不斷發展。許多這些進步都是由動作捕捉技術推動的,這種技術始終如壹地提供高效、最先進的視覺效果,在我們心愛的超級英雄大片中很常見。

人物動畫研究領域的創造潛力是無窮無盡的。

“角色動畫代表了計算機圖形學中壹個真正獨特的領域。角色動畫的目標是復制生物的智能和行為,這不僅適用於人類和動物,也適用於想象中的生物,”北京大學助理教授劉立斌說,他將和他的團隊壹起展示新的研究成果,作為SIGGRAPH 2023技術論文項目的壹部分。

劉說:“多年來,研究界已經探索了許多實現這壹目標的方法……隨著我們在人工智能方面看到的令人興奮的進展,利用大型語言模型或更全面的多模態模型作為角色的‘大腦’的研究將會蓬勃發展,再加上新的動作表示和生成框架的發展,將大腦的‘思想’轉化為現實的行動。”“對於這個領域的所有人來說,這是壹個激動人心的時刻。”

作為熱門技術論文計劃的預覽,這裏是三種獨特方法的焦點,展示了進壹步推進角色動畫領域的創新。

肢體語言

我們中的許多人會無意識地用肢體語言交流或表達自己。我們中的壹些人在說話時可能會用手做手勢,改變身體姿勢來表達觀點,或者在身體的另壹個部位(眼睛或腿)做出動作。事實上,語言和交流與肢體動作密切相關——這是壹個復雜的數字序列。

來自中國北京大學和通用人工智能國家重點實驗室的壹組研究人員引入了壹個復雜的計算框架,可以捕捉人類肢體語言手勢的細微差別。這個框架允許用戶使用廣泛的輸入數據來控制這些細節,包括壹段文字描述,壹個簡短的演示片段,甚至是代表動物姿態的數據,比如壹只鳥拍打或展開翅膀的視頻。

支撐該團隊新系統的關鍵組件是壹種新的運動表示,特別是量化潛在運動嵌入,再加上擴散模型——這是最近人工智能驅動的圖像生成技術背後的關鍵組件之壹。這種表現方式大大減少了歧義,並確保了運動的自然和多樣性。此外,他們還增強了OpenAI開發的CLIP模型,使其能夠以多種形式解釋風格描述,並開發了壹種高效的句子分析技術,使數字角色能夠理解語音的語義並確定最佳的手勢時間。

在數字人類領域取得的進步的基礎上,這項新工作解決了制造數字角色的挑戰,這些數字角色能夠在對話中做出肢體動作,並且只需要很少的指導或指令。該系統支持短文本、動作序列或視頻剪輯形式的樣式提示,並提供特定於身體部位的樣式控制;例如,將瑜伽姿勢(戰士式)與感覺“快樂”或“悲傷”的手勢結合起來。

“有了這項工作,我們離讓數字人類像現實生活中的人壹樣又近了壹步。該研究的主要作者、北京大學智能科技學院助理教授劉說:“我們的系統使這些虛擬角色能夠在對話中表現出自然和多樣化的手勢,從而大大增強了互動的真實感和沈浸感。”

“也許這項技術最令人興奮的方面是它能夠讓用戶通過語言和演示直觀地控制角色的動作。這也使系統能夠與ChatGPT等先進的人工智能無縫對接,為我們的數字角色帶來更高水平的智能和逼真度。”

劉和他的合作者,來自北京大學的奧騰龍和張澤毅,在SIGGRAPH 2023上展示了他們的新作品。在他們的項目頁面上查看團隊的論文和附帶的視頻。

運動中的逼真機器人

誰不喜歡跳舞的機器人呢?但是,如何輕松地復制或模擬有腿機器人及其動態運動仍然是角色動畫領域的壹個挑戰。在壹項新的研究中,來自迪士尼研究工程和蘇黎世聯邦理工學院的壹個國際研究小組描述了壹種創新技術,可以將富有表現力的物理運動最佳地重新定位到自由行走的機器人上。

從動作捕捉數據或其他數字藝術創作來源重新定位動作或編輯現有動作,是在數字世界中模擬物理動作的壹種更快的方法。考慮到運動數據的比例、質量分布和自由度的顯著差異,將它們編輯到不同的系統中是最具挑戰性的。

為此,這項新技術可以將捕捉到的或藝術家提供的動作重新定位到比例和質量分布截然不同的有腿機器人上。

研究人員指出:“我們可以輸入壹個動作,然後自動求解出機器人執行該動作的最佳方式。”他們的方法考慮了機器人動力學和機器人的驅動限制,這意味著即使是高度動態的運動也可以成功地重新定位。結果是,機器人可以在不失去平衡的情況下完成運動——這不是壹件容易的事。

後者是團隊用這種新方法克服的主要障礙。由於動物或藝術家創建的鉆機和有腿機器人之間的大小,形狀存在顯著差異,因此很難通過標準的最優控制技術和手動試錯方法實現運動的重新定位。

研究人員的方法是壹種可微分最優控制(DOC)技術,該技術允許他們求解壹組全面的參數,使重定向不受比例、質量分布以及輸入運動源與實際物理機器人之間的自由度數量差異的影響。

DOC背後的團隊包括迪斯尼研究院的Ruben Grandia、Espen Knoop、Christian Schumacher和Moritz Bächer,以及ETH zrich的Farbod Farshidian和Marco Hutter。他們將作為SIGGRAPH 2023技術論文計劃的壹部分展示他們的工作。有關論文和視頻,請訪問該團隊的項目頁面。

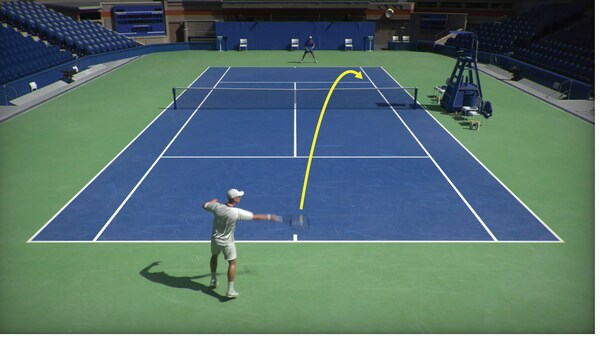

網球,有人知道嗎?

電腦遊戲愛好者的終極夢想是能夠在虛擬世界中控制他們的玩家,以壹種反映玩家在現實世界中的運動能力和動作的方式。遊戲的真實性才是最重要的。

壹個由計算機科學家組成的全球團隊(其中壹人也是網球專家和NCAA網球冠軍)開發了壹種基於物理的動畫系統,該系統僅使用視頻中的運動數據就可以產生多種復雜的網球比賽技巧。該團隊的計算框架使兩個模擬角色能夠參與廣泛的網球比賽,由從不同球員的比賽視頻中學習到的控制器引導。

“我們的工作展示了利用互聯網上豐富的體育視頻來創造可以控制的虛擬人物的令人興奮的可能性。這項新研究的第壹作者、斯坦福大學計算機科學副教授凱馮·法塔利安(Kayvon Fatahalian)門下的博士生張浩天(音譯)說:“它開啟了壹個未來,任何人都可以用自己的視頻將虛擬人物帶入生活。”張浩天和法塔利安在SIGGRAPH 2023上展示了他們的工作,以及來自NVIDIA,多倫多大學,矢量研究所和西蒙弗雷澤大學的合作者。

“想象壹下,現在各種背景的人都可以負責動畫制作,讓他們的想法變得生動,這是多麽令人難以置信的創造力和便利。”“潛力是無限的,現在每個人都可以輕松地實現虛擬角色的動畫化。”

研究人員通過許多例子來展示這個系統,包括復制不同的球員風格,比如右手球員使用雙手反手,反之亦然,以及捕捉不同的網球技巧,比如發球、正手上旋球和反手削球,等等。該系統可以通過模擬球拍和控球動態來產生兩個物理模擬人物進行長時間的網球拉力賽。

除了張浩天和法塔利安, NVIDIA的合作者Ye Yuan, Viktor Makoviychuk和Yunrong Guo,多倫多大學的Sanja Fidler以及NVIDIA和西蒙弗雷澤大學的薛斌彭都在SIGGRAPH 2023上展示了他們的成果。完整的論文和視頻,請訪問該團隊的頁面。

每年,SIGGRAPH技術論文計劃涵蓋從動畫,仿真和成像到幾何,建模,人機交互,制造,機器人等研究領域。通過觀看SIGGRAPH 2023技術論文預告片來了解今年的內容,並查看完整的程序以了解更多細節。訪問SIGGRAPH 2023網站註冊。

關於ACM、ACM SIGGRAPH和SIGGRAPH 2023

ACM(美國計算機協會)是世界上最大的教育和科學計算協會,它將教育工作者、研究人員和專業人士聯合起來,激發對話,共享資源,並應對該領域的挑戰。ACM SIGGRAPH是ACM內部的壹個特殊興趣小組,為計算機圖形學和交互技術的研究、技術和應用方面的成員提供跨學科社區服務。SIGGRAPH會議是世界領先的年度跨學科教育經驗,展示了最新的計算機圖形學和交互技術。SIGGRAPH 2023是由ACM SIGGRAPH主辦的第50屆年會,將於8月6日至10日在洛杉磯會議中心現場舉行,並提供虛擬訪問選項。