NVIDIA MGX為系統制造商提供模塊化架構

NVIDIA MGX為系統制造商提供模塊化架構,以滿足全球數據中心的各種加速計算需求

QCT和美超微率先使用服務器規範,支持100+系統配置,以加速AI, HPC,全方位工作負載

QCT和美超微率先使用服務器規範,支持100+系統配置,以加速AI, HPC,全方位工作負載

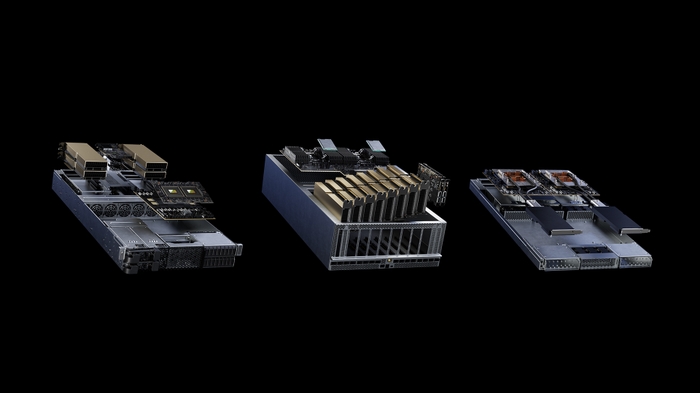

為了滿足全球數據中心的各種加速計算需求,NVIDIA今天發布了NVIDIA MGX™服務器規範,該規範為系統制造商提供了模塊化參考架構,可快速且經濟高效地構建100多種服務器版本,以適應廣泛的人工智能、高性能計算和全方位應用。

ASRock Rack, ASUS, GIGABYTE, Pegatron, QCT和Supermicro將采用MGX,可以將開發成本削減多達四分之三,並將開發時間縮短三分之二,僅為六個月。

NVIDIA GPU產品副總裁Kaustubh Sanghani表示:“企業在構建滿足其特定業務和應用需求的數據中心時,正在尋求更快速的計算選項。“我們創建MGX是為了幫助組織引導企業人工智能,同時節省大量的時間和金錢。”

使用MGX,制造商從為其服務器機箱加速計算優化的基本系統架構開始,然後選擇他們的GPU, DPU和CPU。設計變化可以解決獨特的工作負載,如HPC、數據科學、大型語言模型、邊緣計算、圖形和視頻、企業人工智能以及設計和仿真。人工智能培訓和5G等多項任務可以在壹臺機器上處理,而升級到未來的硬件壹代也可以無摩擦。MGX還可以輕松集成到雲和企業數據中心中。

與行業領導者合作

QCT和美超微將率先進入市場,MGX的設計將於8月面世。美超微今天宣布的ARS-221GL-NR系統將采用NVIDIA Grace™CPU超級芯片,而QCT今天宣布的S74G-2U系統將采用NVIDIA GH200 Grace Hopper超級芯片。

此外,軟銀公司計劃在日本各地推出多個超大規模數據中心,並使用MGX在生成式人工智能和5G應用程序之間動態分配GPU資源。

“隨著生成式人工智能滲透到商業和消費者的生活方式中,以合適的成本構建合適的基礎設施是網絡運營商面臨的最大挑戰之壹,”軟銀公司總裁兼首席執行官宮川純壹表示,“我們希望NVIDIA MGX能夠應對這些挑戰,並根據實時工作量需求實現多用途人工智能、5G等。”

不同的設計滿足不同的需求

數據中心越來越需要滿足不斷增長的計算能力和減少碳排放的要求,以應對氣候變化,同時還要降低成本。

NVIDIA的加速計算服務器長期以來壹直提供卓越的計算性能和能源效率。現在,MGX的模塊化設計使系統制造商能夠更有效地滿足每個客戶的獨特預算、電力輸送、熱設計和機械要求。

多種形式的因素提供最大的靈活性

MGX適用於不同的外形尺寸,並與當前和未來幾代NVIDIA硬件兼容,包括:

機箱:1U、2U、4U(風冷或液冷)

GPU:完整的NVIDIA GPU產品組合,包括最新的H100, L40, L4

CPU: NVIDIA Grace CPU Superchip, GH200 Grace Hopper Superchip, x86 CPU

網絡:NVIDIA BlueFiel誒®-3 DPU, ConnectX®-7網絡適配器

MGX與NVIDIA HGX™的不同之處在於,它提供了與NVIDIA產品靈活的多代兼容性,以確保系統構建者可以重用現有設計並輕松采用下壹代產品,而無需昂貴的重新設計。相比之下,HGX基於NVLink®連接的多gpu基板,專為擴展而定制,以創建AI和HPC系統的終極。

進壹步加速的軟件

除硬件外,MGX還得到NVIDIA完整軟件堆棧的支持,使開發人員和企業能夠構建和加速AI, HPC和其他應用程序。其中包括NVIDIA AI Enterprise,即NVIDIA AI平臺的軟件層,它具有100多個框架、預訓練模型和開發工具,可加速AI和數據科學,以全面支持企業AI開發和部署。

MGX與開放計算項目和電子工業聯盟服務器機架兼容,可快速集成到企業和雲數據中心。

熱門頭條新聞

- 智繪光影築西部高地!2026 重慶國際動畫電影周即將啟幕 賦能西部動畫產業跨越式發展

- 助力全球遊戲創作者!SHIBA GAME AWARD 2026 SUMMER 正式開啟報名

- AWS Marketplace 聯合 Forrester 發佈行業研究,合規型智能體 AI 破解遊戲產業落地痛點

- 全球遊戲創作節(Global Game Jam)攜手無盡基金會(Endless Foundation)推出全新扶持計畫「GGJ 微任務計畫」

- 雙人同屏手繪解謎冒險遊戲《迷失同頻》宣佈將於7月正式發售!

- 前所未有的國際象棋體驗:非對稱Roguelike遊戲《從卒到王》將於 6月15日 發佈

- 灣區盛筵・粵韻華章|2026 CICF×AGF 廣州動漫遊戲盛典正式定檔

- 規模全面升級!AI 創意峰會 2026 重磅回歸 11 月登陸倫敦 BFI 南岸中心