NVIDIA MGX为系统制造商提供模块化架构

NVIDIA MGX为系统制造商提供模块化架构,以满足全球数据中心的各种加速计算需求

QCT和美超微率先使用服务器规范,支持100+系统配置,以加速AI, HPC,全方位工作负载

为了满足全球数据中心的各种加速计算需求,NVIDIA今天发布了NVIDIA MGX™服务器规范,该规范为系统制造商提供了模块化参考架构,可快速且经济高效地构建100多种服务器版本,以适应广泛的人工智能、高性能计算和全方位应用。

ASRock Rack, ASUS, GIGABYTE, Pegatron, QCT和Supermicro将采用MGX,可以将开发成本削减多达四分之三,并将开发时间缩短三分之二,仅为六个月。

NVIDIA GPU产品副总裁Kaustubh Sanghani表示:“企业在构建满足其特定业务和应用需求的数据中心时,正在寻求更快速的计算选项。“我们创建MGX是为了帮助组织引导企业人工智能,同时节省大量的时间和金钱。”

使用MGX,制造商从为其服务器机箱加速计算优化的基本系统架构开始,然后选择他们的GPU, DPU和CPU。设计变化可以解决独特的工作负载,如HPC、数据科学、大型语言模型、边缘计算、图形和视频、企业人工智能以及设计和仿真。人工智能培训和5G等多项任务可以在一台机器上处理,而升级到未来的硬件一代也可以无摩擦。MGX还可以轻松集成到云和企业数据中心中。

与行业领导者合作

QCT和美超微将率先进入市场,MGX的设计将于8月面世。美超微今天宣布的ARS-221GL-NR系统将采用NVIDIA Grace™CPU超级芯片,而QCT今天宣布的S74G-2U系统将采用NVIDIA GH200 Grace Hopper超级芯片。

此外,软银公司计划在日本各地推出多个超大规模数据中心,并使用MGX在生成式人工智能和5G应用程序之间动态分配GPU资源。

“随着生成式人工智能渗透到商业和消费者的生活方式中,以合适的成本构建合适的基础设施是网络运营商面临的最大挑战之一,”软银公司总裁兼首席执行官宫川纯一表示,“我们希望NVIDIA MGX能够应对这些挑战,并根据实时工作量需求实现多用途人工智能、5G等。”

不同的设计满足不同的需求

数据中心越来越需要满足不断增长的计算能力和减少碳排放的要求,以应对气候变化,同时还要降低成本。

NVIDIA的加速计算服务器长期以来一直提供卓越的计算性能和能源效率。现在,MGX的模块化设计使系统制造商能够更有效地满足每个客户的独特预算、电力输送、热设计和机械要求。

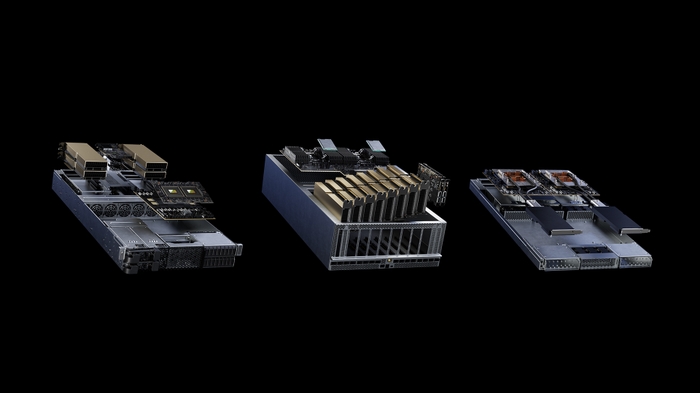

多种形式的因素提供最大的灵活性

MGX适用于不同的外形尺寸,并与当前和未来几代NVIDIA硬件兼容,包括:

机箱:1U、2U、4U(风冷或液冷)

GPU:完整的NVIDIA GPU产品组合,包括最新的H100, L40, L4

CPU: NVIDIA Grace CPU Superchip, GH200 Grace Hopper Superchip, x86 CPU

网络:NVIDIA BlueField®-3 DPU, ConnectX®-7网络适配器

MGX与NVIDIA HGX™的不同之处在于,它提供了与NVIDIA产品灵活的多代兼容性,以确保系统构建者可以重用现有设计并轻松采用下一代产品,而无需昂贵的重新设计。相比之下,HGX基于NVLink®连接的多gpu基板,专为扩展而定制,以创建AI和HPC系统的终极。

进一步加速的软件

除硬件外,MGX还得到NVIDIA完整软件堆栈的支持,使开发人员和企业能够构建和加速AI, HPC和其他应用程序。其中包括NVIDIA AI Enterprise,即NVIDIA AI平台的软件层,它具有100多个框架、预训练模型和开发工具,可加速AI和数据科学,以全面支持企业AI开发和部署。

MGX与开放计算项目和电子工业联盟服务器机架兼容,可快速集成到企业和云数据中心。